Suite et fin ici des trois articles présentant une introduction à l’écoute du son et l’art du mixage. Après les dimensions fréquentielles et dynamiques du son, la spatialisation est le troisième domaine capital dans un mixage. Il est en effet très important de comprendre les paramètres qui entrent en jeu dans la perception et la cohérence de l’espace sonore. Ensuite, je te présenterai brièvement en quoi les trois domaines (fréquentiel, dynamique et spatial) sont intimement liés. Car l’analyse de tout objet sonore ne peut se faire sur base d’un seul paramètre pris individuellement. Par exemple, écoutes les deux extraits audio qui suivent:

A ton avis, quelles différences as-tu noté entre les deux?

Tu vas sûrement me répondre, à raison, que l’un est plus fort que l’autre. En effet, c’est la réponse si on analyse ce son d’un point de vue dynamique.

D’un point de vue de l’espace sonore, on pourrait dire aussi que l’un est plus éloigné que l’autre.

Et qu’en est-il des fréquences?

Si tu possèdes déjà une écoute attentive, tu remarqueras une présence bien plus importante en fréquences graves dans le son qui est plus fort!

On voit déjà ici dans un exemple simple ce qui peut influencer le paramètre de profondeur dans un mixage. Tout cela relève de la psycho-acoustique. Et c’est ce qui fait tout l’art du mixage, qui est un processus très technique et complexe.

L'espace sonore

En mixage, on va vouloir souvent imaginer les instruments placés dans l’espace; chacun à leur place, comme si un groupe jouait en concert sur une scène. On peut visualiser ces instruments de la gauche vers la droite (l’image Stereo) et sur le devant jusqu’au fond en arrière (la profondeur).

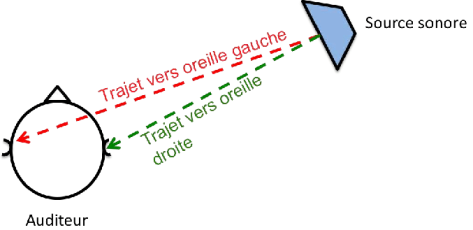

La localisation des sons par notre cerveau

Du mono vers la stéréo

Historiquement, il faut savoir que pendant longtemps (jusque dans les années 60), la musique s’enregistrait en Mono avec un seul micro pour capter l’ensemble des instruments. L’instrument le plus fort dominait alors le tout.

Puis arriva la stéréophonie et le début des expérimentations des sons dans l’espace. En écoutant de vieux enregistrements de Jazz ou des Beatles, on tombe souvent sur des morceaux qui peuvent paraître loufoques aujourd’hui. A l’époque où on utilisait un enregistreur 2 pistes (voire 4 pistes pour la haute technologie), le placement des instruments dans l’espace était encore expérimental. D’ailleurs, il s’agissait d’un simple placement en sources réelles. A l’inverse de la vraie stéréo où notre cerveau a les informations pour recalculer un espace sonore cohérent (sources virtuelles).

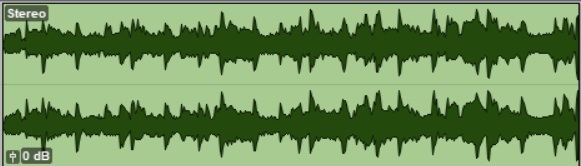

Mais quelle est la différence entre mono et stéréo?

Ecoutes la différence de largeur entre le fichier Mono et le même en Stéréo (Appuis sur Play et Switches entre les boutons Stéréo est Mono, écoutes au casque si possible):

Vue d’une piste du mixeur Pro Tools avec le réglage du Pan au-dessus du Fader

Ce n’est en fait rien d’autre qu’un réglage de gain (niveau sonore) entre la sortie gauche ou droite.

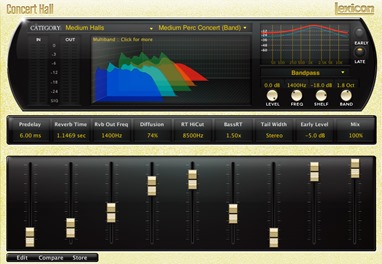

La réverbération

Un son émis dans un environnement particulier, de par sa texture, sa nature et de sa taille approximative, engendre un motif unique de diverses réflexions. Ce motif propre à cet endroit donne une couleur sonore que l’on appelle réverbération (ou reverb).

Dans l’audio sans reverb appliquée, les 3 éléments sont sur le même plan sonore tout devant. Sur l’extrait avec la reverb, tu peux remarquer qu’elle est appliquée sur le shaker et les percus ce qui donne 3 plans sonores différents.

Ces sont ces deux outils principalement (Delay et Reverb) qui permettent de donner une dimension d’espace au son; de faire passer un son Mono vers un son en Stéréo et dans la profondeur.

Récapitulatif des trois domaines du son

Mesure physique: Fréquence en Hz

Perception subjective: Pitch, « couleur » sonore

Outil de traitement: EQ

Mesure physique: Intensité en dB

Perception subjective: Loudness

Outil de traitement: Fader, Compresseur/Gate/Limiteur…

Mesure physique: Temps de reverb en sec

Temps de delay en ms

Corrélateur de phase

Perception subjective: « Largeur stéréo », espace réaliste/artificiel

Outil de traitement: Pan, Delay, Reverb

Art du mixage et psycho-acoustique

Seulement voilà: la réalité est toute autre. Ce n’est pas aussi simple que cela.

Augmenter le volume perçu des guitares n’est pas sans conséquences sur le reste des éléments du mix (la voix notamment), mais aussi sur les guitares elle-mêmes et leur contenu fréquentiel ou leur placement dans l’espace!

D’une part, on a vu que le son peut être décrit physiquement grâce à des appareils pouvant mesurer un paramètre à la fois, de manière très précise. Mais d’un autre côté, il y a nos oreilles et l’analyse du son par notre cerveau qui elle, est bien plus complexe. Cette analyse des phénomènes sonores s’appelle la psycho-acoustique.

D’autre part, comme je l’ai dit en introduction, il est primordial en mixage audio de savoir que ces trois domaines du son sont intimement interconnectés.

Sur l’effet de profondeur par exemple: on a déjà pu constater que plusieurs paramètres entrent en jeu et agissent en même temps. Un son plus éloigné sera moins fort, mais aussi contiendra moins de fréquences dans l’extrême grave et aigue, ou encore la proportion de son réverbéré sera plus importante que celle de son direct. Tu auras aussi constaté que lorsque tu t’éloignes d’un endroit avec de la musique (un club, une salle de concert), les sons graves prédominent par rapport au reste. En effet, à la même intensité, les sons aigus portent moins loin que les sons graves.

L’intensité, la hauteur, la durée et l’espace sonore sont des variables qui ne sont pas “étanches” les unes par rapport aux autres: le fait même d’en modifier une, se répercute sur l’autre soit de façon réelle c’est-à-dire évaluable physiquement ou subjective c’est-à-dire perceptible à l’oreille donc à travers le décodage du cerveau. La somme de toutes ces quantités psycho-acoustiques va être évaluée et rassemblée par notre cerveau.

Et la conséquence de tous ces phénomènes sur le son aura une importance capitale dans ta façon de mixer la musique. Tu ne seras jamais un mixeur assez compétent si tu n’as pas la connaissance des courbes de Fletcher & Munson ou comment éviter un filtrage en peigne!

Pas de panique! Toutes ces nouvelles notions seront bien sûr abordées ultérieurement.

Conclusion: entraîner son oreille à la perception du son

Tu sais maintenant ce qui te reste à explorer afin de devenir un as de la production et du mixage audio

Mais ce que je te propose tout de suite, c’est d’entraîner ton écoute de deux manières différentes:

– par l’écoute passive

L’entraînement à l’écoute passive peut se faire à tout moment (se sensibiliser à l’acoustique d’un endroit particulier, tester la reverb dans un hangar en tapant des mains ou divers objets, reconnaître les effets utilisés pendant un concert, …). L’écoute passive doit être une activité permanente. Titiller les connections dans ton oreille/cerveau régulièrement va accroître ton habileté à détecter de fines différences sonores. En écoutant attentivement les sons quotidiens autour de toi, tu trouveras par toi-même des parallèles avec divers aspects de la production musicale.

– par l’écoute active

Elle intervient pendant que tes mains ont un contrôle sur le son (sur un outil d’égalisation ou un compresseur par exemple). Il ne s’agit pas de se contenter d’écouter des tonalités ou du bruit mais de savoir quoi écouter dans un mix, sur quel son se focaliser en terme de dynamique ou de fréquence.

C’est impressionnant à quelle vitesse tu vas développer ton écoute critique et détecter le moindre changement de sonorité. Ce sont des exercices bénéfiques à long terme sur tes productions.

Catégories

Derniers articles publiés

Tu cherches à maîtriser les outils modernes de la production musicale, traiter ton son comme il le mérite, en finir avec les blocages et finaliser tes morceaux une bonne fois pour toute?

Tu es au bon endroit! Je m’appelle Martin, et je partage avec toi toutes mes connaissances et expérience en ingénierie du son.

De nos jours, il est possible de faire (presque) tout depuis chez soi! Avec les bonnes connaissances, de l’abnégation et de la passion, je suis convaincu que la création musicale est accessible à tous. Je suis prêt à partager ici avec le plus de pédagogie possible, tous les conseils et astuces qui te seront d’une aide précieuse pour arriver à tes fins.

Génial, très complet comme toujours, ces articles permettent de mieux comprendre le mixage.